Web Scraping

profesjonalne pobieranie danych ze stron internetowych

Efektywny scraping danych z każdej strony internetowej, przekształcając je w wartościowe informacje. U nas dostaniesz tylko dokładne i aktualne dane. Pozyskujemy dowolne dane z dowolnego źródła.

Data extraction i automatyzacja danych

dla rozwoju twojego biznesu

Kilka przykładowych branż dla których świadczymy usługi ekstrakcji danych i crawling.

Monitorowanie cen konkurencji

Ekstrakcja danych cenowych pozwala na bieżące śledzenie zmian cenowych w branży. Dzięki temu można szybko dostosowywać własne ceny, aby pozostać konkurencyjnym i przyciągać więcej klientów. To rozwiązanie umożliwia strategiczne zarządzanie polityką cenową.

Pobieranie produktów

Budowanie obszernej bazy produktowej jest łatwe dzięki ekstrakcji danych produktowych z wielu źródeł internetowych. Dzięki temu można szybko zaimportować pełne katalogi towarów do sklepu internetowego, co pozwala na szybsze rozszerzenie oferty. Ponadto ta usługa oszczędza czas i zapewnia aktualizacje produktów.

Pobieranie opinii o produktach

Aby lepiej zrozumieć potrzeby i oczekiwania klientów, należy zebrać recenzje produktów z różnych źródeł. W celu zwiększenia sprzedaży i budowania zaufania sklep internetowy może wykorzystać te cenne informacje. Dzięki temu możliwe jest również szybsze rozwiązywanie problemów i lepsza oferta.

Powyżej przedstawiliśmy jedynie przykłady danych, które możemy dla Ciebie pozyskać.

Dlaczego warto wybrać nasze usługi web scrapingu?

Skutecznie pozyskujemy dane dzięki zaawansowanym technologiom, doświadczeniu i elastycznym rozwiązaniom dostosowanym do indywidualnych potrzeb naszych klientów.

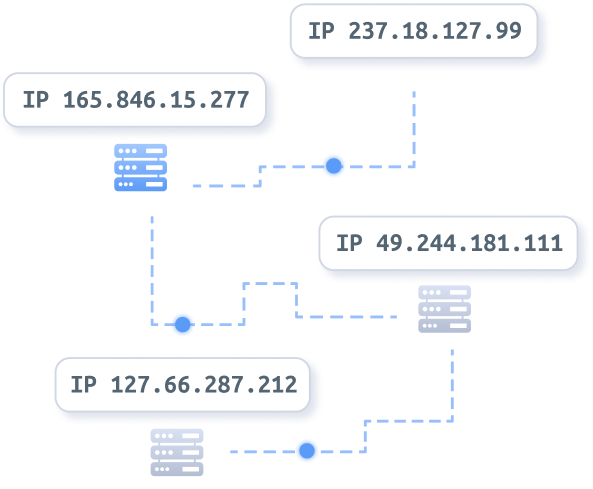

Infrastruktura Proxy

Automatyczna

zmiana adresów IP

- Adresy IP z ponad 195 krajów

- 100% prywatność

- Nielimitowana przepustowość

Rozwiązanie Captcha

Wypracowaliśmy sposoby na rozwiązywania CAPTCHy

Przeglądarka

Symulacja prawdziwej przeglądarki w sieci

Własne serwery

Posiadamy własną infrastrukturę serwerową

PROgramiści

Zespół profesjonalnych programistów pod ręką

Gotowe rozwiązania

Dzięki wieloletniemu doświadczeniu wypracowaliśmy sporo gotowych rozwiązań

- Szeroka baza danych kontaktowych

- Panele do samodzielnego zarządzania scrapingiem

- Dużo gotowych scraperów

Jak działamy

Proces współpracy przy ekstrakcji i agregacji danych

Ustalenie źródła i ilości danych

Wspólnie określamy jakie dane i skąd mają być pozyskiwane. Definiujemy zakres, częstotliwość i format dostarczanych danych.

Analiza witryny i szacowany koszt

Analizujemy techniczną złożoność strony, zabezpieczenia oraz wolumen danych, aby przygotować rzetelną wycenę projektu.

Stworzenie scrapera i agregacja danych

Budujemy dedykowany scraper dostosowany do specyfiki strony i zbieramy dane zgodnie z ustalonym harmonogramem.

Weryfikacja danych i rozliczenie

Sprawdzamy jakość i kompletność pobranych danych, dostarczamy je w ustalonym formacie i dokonujemy rozliczenia projektu.

Formaty danych

Pobieranie danych ze strony do Excela

Przygotowane pliki są najczęściej pobierane w formatach XLSX, XLS, CSV, JSON, XML, SQL. Dostarczamy zebrane dane w formacie idealnie dopasowanym do Twoich potrzeb - od popularnych arkuszy kalkulacyjnych po bezpośrednią integrację przez API.

Przykładowe źródła danych

Oto kilka przykładowych źródeł z których często pobieramy dane.

Potrzebujesz dane ze strony internetowej?

Skorzystaj z naszych profesjonalnych usług web scrapingu. Pozyskujemy dokładne i aktualne dane z dowolnych źródeł, dostarczając je w formacie gotowym do analizy. Zbuduj przewagę konkurencyjną opartą na danych!

Usługa Web Scrapingu – czyli pobieranie danych ze stron internetowych

Usługa web-scrapingu, która oznacza pobieranie danych ze stron internetowych to współczesna metoda, która pozwala na automatyczną ekstrakcję danych z witryn internetowych. Proces ten obejmuje zbieranie danych ze stron www za pomocą specjalnych narzędzi i skryptów, które przetwarzają dane z tych stron i przekształcają je w strukturyzowane dane gotowe do analizy i wykorzystania. Dla firm i organizacji, które potrzebują regularnie aktualizowanych informacji z różnych źródeł internetowych, scraping jest niezwykle przydatny.

W jaki sposób usługa web scrapingu może być korzystna? Przede wszystkim automatyczne pozyskiwanie danych pozwala na oszczędność czasu i zasobów. Tradycyjne techniki zbierania danych, takie jak ręczne przeszukiwanie stron internetowych, są trudne i podatne na błędy. Zapewniając szybkie i dokładne pobieranie danych ze stron internetowych, scraping internetowy rozwiązuje te problemy. Zamiast tracić czas na ręczne zbieranie danych, firmy mogą skupić się na analizie zebranych informacji i podejmowaniu strategicznych decyzji.

W dzisiejszych czasach, gdy ilość dostępnych danych jest ogromna i ciągle rośnie, ekstrakcja danych ze stron internetowych jest szczególnie ważna. Aby uzyskać dostęp do tych danych w uporządkowany sposób, web scraping jest niezbędny dla firm działających w różnych branżach.

W branży e-commerce wykorzystuje się scraping internetowy do monitorowania cen konkurencji, badania trendów rynkowych i zbierania opinii klientów. Pozyskiwanie danych ze stron internetowych pozwala na utrzymywanie konkurencyjności na dynamicznie zmieniającym się rynku. Firmy mogą zwiększyć sprzedaż i zadowolenie klientów, reagując na zmiany cen i modyfikując strategie marketingowe.

Finanse wykorzystują web scraping do zbierania danych rynkowych, analizowania trendów giełdowych i śledzenia informacji o konkurencji. Szybki dostęp do ważnych informacji, które są niezbędne do podejmowania świadomych decyzji inwestycyjnych, jest możliwy dzięki gromadzeniu danych online. W ten sposób firmy finansowe mogą lepiej zarządzać swoimi portfelami inwestycyjnymi i przewidywać zmiany na rynku.

W marketingu ekstrakcja danych ze stron internetowych umożliwia analizę kampanii reklamowych, śledzenie opinii w mediach społecznościowych i badanie zachowań konsumentów. Za pomocą scrapingu internetowego można zbierać dane z różnych platform i źródeł, co daje pełniejszy obraz rynku i pomaga w tworzeniu skuteczniejszych strategii marketingowych. W wyniku lepszego zrozumienia potrzeb i preferencji klientów firmy mogą tworzyć bardziej dostosowane i efektywne kampanie reklamowe.

W branży nieruchomości wykorzystuje się scraping internetowy do monitorowania ogloszeń. monitorowanie ogłoszeń i badanie trendów na rynku nieruchomości. Za pomocą pozyskiwania danych ze stron internetowych agenci i deweloperzy mogą szybko uzyskać dostęp do najnowszych ofert i analiz cen w czasie rzeczywistym. W ten sposób mogą lepiej doradzać swoim klientom i podejmować bardziej świadome decyzje inwestycyjne.

Ekstrakcja danych ze stron internetowych ma również zastosowanie w edukacji. Umożliwia zbieranie informacji o opiniach studentów, trendach edukacyjnych i programach nauczania. Pozyskiwanie danych ze stron internetowych pomaga instytucjom edukacyjnym zapewnić wyższy poziom kształcenia i lepiej dostosować swoje oferty do potrzeb rynkowych.

Podsumowując, scraping internetowy to potężne narzędzie, które umożliwia szybkie i skuteczne pozyskiwanie danych z internetu. Firmy z różnych branż czerpią korzyści z ekstrakcji danych ze stron internetowych, ponieważ pozwala im zaoszczędzić czas, zasoby i być bardziej konkurencyjnymi. Firmy mogą lepiej podejmować decyzje i odnieść większy sukces na rynku, automatyzując proces zbierania danych.

Często zadawane pytania

Proces automatycznego pobierania danych ze stron internetowych jest znany jako web-scraping. Działa poprzez skrypty lub narzędzia, które przeglądają strony internetowe i wydobywają wymagane dane, które są gotowe do analizy i wykorzystania.

Przy web scrapingu przestrzegamy kilku kluczowych zasad: szanujemy pliki robots.txt na stronach, nie obciążamy nadmiernie serwerów, stosujemy opóźnienia między kolejnymi zapytaniami, a także zachowujemy anonimowość (np. przez używanie serwerów proxy). Te praktyki pomagają unikać prawnych i etycznych problemów oraz zwiększają efektywność scrapowania.

Wiele rzeczy decyduje o tym, czy scraping stron internetowych jest legalny, takich jak cel scrapingu, rodzaj pobieranych danych i warunki korzystania ze strony internetowej.

Cena usług web scrapingu zależy od szeregu czynników, w tym od złożoności i technologii strony internetowej, z której dane mają być pozyskane. Kluczowe elementy wpływające na koszt to m.in. mechanizmy zabezpieczające stronę przed scrapowaniem, takie jak reCAPTCHA, szyfrowanie danych czy dynamiczne ładowanie treści. Ponadto, koszt może wzrosnąć w zależności od ilości i rodzaju danych do zebrania, częstotliwości scrapingu oraz potrzeby używania proxy lub VPN do maskowania IP.

Dostarczamy pozyskane dane według potrzeb klienta. Najczęściej używane formaty to CSV, XML, XLS, JSON i SQL, które ułatwiają łatwą integrację z wieloma systemami i aplikacjami. Oferujemy również możliwość dostarczenia danych poprzez API, co pozwala bezpośrednio integrować dane z systemami klienta. Naszym celem jest zapewnienie jak największej elastyczności i wygody dla naszych klientów.